Modelos médicos de IA se basan en ‘atajos’ que podrían conducir a diagnósticos equivocados de la COVID-19

|

Por el equipo editorial de LabMedica en español Actualizado el 29 Jun 2021 |

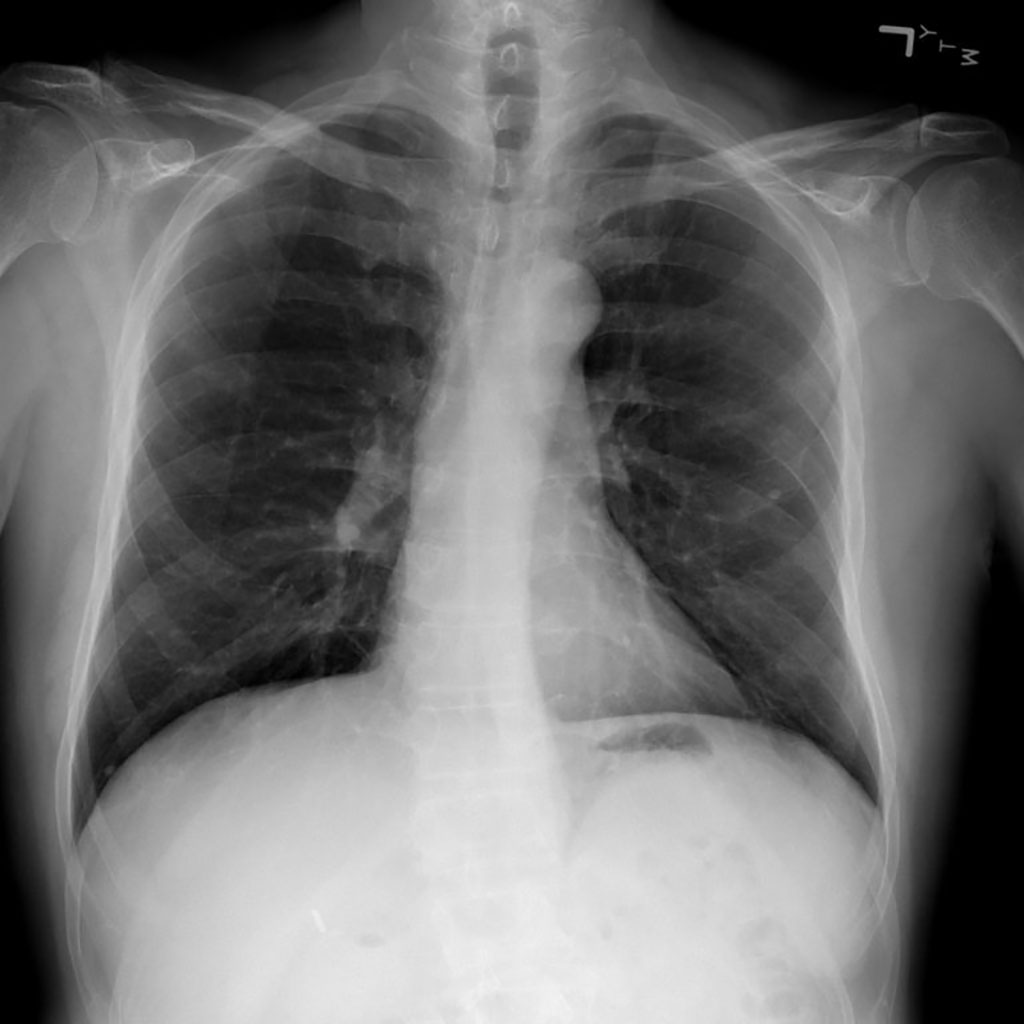

Imagen: Los modelos de IA médica confían en ‘atajos’ que podrían conducir a un diagnóstico erróneo de la COVID-19 (Fotografía cortesía del Centro Clínico de los Institutos Nacionales de Salud)

Los investigadores han descubierto que los modelos de inteligencia artificial médica (IA) se basan en ‘atajos’ que podrían conducir a un diagnóstico erróneo de la COVID-19 y otras enfermedades.

Investigadores de la Facultad de Ciencias e Ingeniería Informática Paul G. Allen de la Universidad de Washington (Seattle, WA, EUA), descubrieron que los modelos de IA, al igual que los humanos, tienden a buscar atajos. En el caso de la detección de enfermedades asistida por IA, tales atajos podrían dar lugar a errores de diagnóstico si se implementan en entornos clínicos. La IA promete ser una herramienta poderosa para mejorar la velocidad y exactitud de la toma de decisiones médicas para mejorar los resultados de los pacientes. Desde el diagnóstico de enfermedades hasta la personalización del tratamiento y la predicción de las complicaciones de la cirugía, la IA podría convertirse en una parte integral de la atención del paciente en el futuro, como lo son hoy las pruebas de diagnóstico por imágenes y de laboratorio.

Sin embargo, cuando los investigadores examinaron varios modelos presentados recientemente como herramientas potenciales para detectar con precisión la COVID-19 a partir de una radiografía de tórax (rayos X), encontraron que, en lugar de aprender una patología médica genuina, estos modelos se basan en el aprendizaje de atajos para dibujar imágenes falsas, asociaciones entre factores médicamente irrelevantes y el estado de la enfermedad. En este caso, los modelos ignoraron los indicadores clínicamente significativos a favor de características como los marcadores de texto o la posición del paciente que eran específicas de cada conjunto de datos para predecir si un individuo tenía COVID-19. Según los investigadores, el aprendizaje de atajos es menos sólido que la patología médica genuina y, por lo general, significa que el modelo no se generalizará bien fuera del entorno original. Combine esa falta de robustez con la opacidad típica de la toma de decisiones de la IA y una herramienta de este tipo podría pasar de ser un posible salvavidas para convertirse en un peligro.

La falta de transparencia es uno de los factores que llevó a los investigadores a centrarse en técnicas de IA explicables para la medicina y la ciencia. Se considera que la mayoría de la IA es como una “caja negra”: el modelo se entrena en conjuntos de datos masivos y arroja predicciones sin que nadie sepa realmente con precisión cómo fue que el modelo obtuvo un resultado determinado. Con una IA explicable, los investigadores y los profesionales pueden comprender, en detalle, cómo varias entradas y sus pesos contribuyeron al reporte hecho por el modelo. El equipo decidió utilizar estas mismas técnicas para evaluar la confiabilidad de los modelos que habían sido promocionados recientemente por lo que parecía ser su capacidad para identificar con exactitud los casos de COVID-19 a partir de una radiografía de tórax.

A pesar de una serie de artículos publicados que anuncian los resultados, los investigadores sospecharon que es posible que algo más suceda dentro de la caja negra que llevó a las predicciones de los modelos. Específicamente, razonaron que tales modelos serían propensos a una condición conocida como confusión del peor de los casos, debido a la escasez de datos de entrenamiento disponibles para una enfermedad tan nueva. Tal escenario aumentó la probabilidad de que los modelos se basen en atajos en lugar de aprender la patología subyacente de la enfermedad a partir de los datos de entrenamiento.

El equipo entrenó múltiples redes neuronales convolucionales profundas en imágenes de radiografía de un conjunto de datos que replicaba el enfoque utilizado en los artículos publicados. Probaron el rendimiento de cada modelo en un conjunto interno de imágenes de ese conjunto de datos inicial que se había retenido de los datos de entrenamiento y en un segundo conjunto de datos externo destinado a representar nuevos sistemas hospitalarios. Descubrieron que, si bien los modelos mantuvieron su alto rendimiento cuando se probaron en imágenes del conjunto de datos interno, su precisión se redujo a la mitad en el segundo conjunto externo, lo que los investigadores denominaron una brecha de generalización y citaron una fuerte evidencia de que los factores de confusión fueron responsables del éxito predictivo de los modelos en el conjunto de datos inicial. Luego, el equipo aplicó técnicas de inteligencia artificial explicables, incluidas las redes generativas adversarias (GAN) y los mapas de prominencia, para identificar qué características de la imagen eran más importantes para determinar las predicciones de los modelos.

Cuando los investigadores entrenaron los modelos en el segundo conjunto de datos, que contenía imágenes extraídas de una sola región y, por lo tanto, se presumió que era menos propenso a generar confusión, resultó no ser el caso; incluso esos modelos mostraron una caída correspondiente en el desempeño cuando se probaron con datos externos. Estos resultados anulan la sabiduría convencional de que la confusión plantea un problema menor cuando los conjuntos de datos se derivan de fuentes similares, y revelan hasta qué punto los llamados sistemas de IA médica de alto rendimiento podrían explotar atajos indeseables en lugar de las señales deseadas. A pesar de las preocupaciones planteadas por sus hallazgos, los investigadores creen que es poco probable que los modelos que estudiaron se hayan implementado ampliamente en el entorno clínico. Si bien hay evidencia de que al menos uno de los modelos defectuosos, COVID-Net, se implementó en varios hospitales, no está claro si se utilizó con fines clínicos o únicamente para la investigación. Según el equipo, los investigadores que buscan aplicar la IA a la detección de enfermedades deberán renovar su enfoque antes de que dichos modelos se puedan usar para tomar decisiones de tratamiento reales para los pacientes.

“Un modelo que se basa en atajos a menudo solo funcionará en el hospital en el que se desarrolló, por lo que cuando se lleva el sistema a un nuevo hospital, falla, y esa falla puede dirigir a los médicos hacia un diagnóstico y un tratamiento incorrectos”, explicó el estudiante de posgrado y coautor principal, Alex DeGrave. “Un médico generalmente esperaría que un hallazgo de COVID-19 en una radiografía se basara en patrones específicos en la imagen que reflejan los procesos de la enfermedad. Pero en lugar de depender de esos patrones, un sistema que utilice el aprendizaje de atajos podría, por ejemplo, juzgar que alguien es mayor y, por lo tanto, inferir que es más probable que tenga la enfermedad porque es más común en pacientes mayores. El atajo no es incorrecto per se, pero la asociación es inesperada y no transparente. Y eso podría llevar a un diagnóstico inadecuado”.

“Nuestros hallazgos apuntan a la importancia de aplicar técnicas de inteligencia artificial explicables para auditar rigurosamente los sistemas de inteligencia artificial médica”, dijo el coautor principal Joseph Janizek. “Si miras un puñado de rayos X, el sistema de IA puede parecer que se comporta bien. Los problemas solo se aclaran una vez que miras muchas imágenes. Hasta que tengamos métodos para auditar estos sistemas de manera más eficiente utilizando un tamaño de muestra mayor, una aplicación más sistemática de IA explicable podría ayudar a los investigadores a evitar algunos de los errores que identificamos con los modelos COVID-19”.

Enlace relacionado:

Facultad de Ciencias e Ingeniería Informática Paul G. Allen de la Universidad de Washington

Investigadores de la Facultad de Ciencias e Ingeniería Informática Paul G. Allen de la Universidad de Washington (Seattle, WA, EUA), descubrieron que los modelos de IA, al igual que los humanos, tienden a buscar atajos. En el caso de la detección de enfermedades asistida por IA, tales atajos podrían dar lugar a errores de diagnóstico si se implementan en entornos clínicos. La IA promete ser una herramienta poderosa para mejorar la velocidad y exactitud de la toma de decisiones médicas para mejorar los resultados de los pacientes. Desde el diagnóstico de enfermedades hasta la personalización del tratamiento y la predicción de las complicaciones de la cirugía, la IA podría convertirse en una parte integral de la atención del paciente en el futuro, como lo son hoy las pruebas de diagnóstico por imágenes y de laboratorio.

Sin embargo, cuando los investigadores examinaron varios modelos presentados recientemente como herramientas potenciales para detectar con precisión la COVID-19 a partir de una radiografía de tórax (rayos X), encontraron que, en lugar de aprender una patología médica genuina, estos modelos se basan en el aprendizaje de atajos para dibujar imágenes falsas, asociaciones entre factores médicamente irrelevantes y el estado de la enfermedad. En este caso, los modelos ignoraron los indicadores clínicamente significativos a favor de características como los marcadores de texto o la posición del paciente que eran específicas de cada conjunto de datos para predecir si un individuo tenía COVID-19. Según los investigadores, el aprendizaje de atajos es menos sólido que la patología médica genuina y, por lo general, significa que el modelo no se generalizará bien fuera del entorno original. Combine esa falta de robustez con la opacidad típica de la toma de decisiones de la IA y una herramienta de este tipo podría pasar de ser un posible salvavidas para convertirse en un peligro.

La falta de transparencia es uno de los factores que llevó a los investigadores a centrarse en técnicas de IA explicables para la medicina y la ciencia. Se considera que la mayoría de la IA es como una “caja negra”: el modelo se entrena en conjuntos de datos masivos y arroja predicciones sin que nadie sepa realmente con precisión cómo fue que el modelo obtuvo un resultado determinado. Con una IA explicable, los investigadores y los profesionales pueden comprender, en detalle, cómo varias entradas y sus pesos contribuyeron al reporte hecho por el modelo. El equipo decidió utilizar estas mismas técnicas para evaluar la confiabilidad de los modelos que habían sido promocionados recientemente por lo que parecía ser su capacidad para identificar con exactitud los casos de COVID-19 a partir de una radiografía de tórax.

A pesar de una serie de artículos publicados que anuncian los resultados, los investigadores sospecharon que es posible que algo más suceda dentro de la caja negra que llevó a las predicciones de los modelos. Específicamente, razonaron que tales modelos serían propensos a una condición conocida como confusión del peor de los casos, debido a la escasez de datos de entrenamiento disponibles para una enfermedad tan nueva. Tal escenario aumentó la probabilidad de que los modelos se basen en atajos en lugar de aprender la patología subyacente de la enfermedad a partir de los datos de entrenamiento.

El equipo entrenó múltiples redes neuronales convolucionales profundas en imágenes de radiografía de un conjunto de datos que replicaba el enfoque utilizado en los artículos publicados. Probaron el rendimiento de cada modelo en un conjunto interno de imágenes de ese conjunto de datos inicial que se había retenido de los datos de entrenamiento y en un segundo conjunto de datos externo destinado a representar nuevos sistemas hospitalarios. Descubrieron que, si bien los modelos mantuvieron su alto rendimiento cuando se probaron en imágenes del conjunto de datos interno, su precisión se redujo a la mitad en el segundo conjunto externo, lo que los investigadores denominaron una brecha de generalización y citaron una fuerte evidencia de que los factores de confusión fueron responsables del éxito predictivo de los modelos en el conjunto de datos inicial. Luego, el equipo aplicó técnicas de inteligencia artificial explicables, incluidas las redes generativas adversarias (GAN) y los mapas de prominencia, para identificar qué características de la imagen eran más importantes para determinar las predicciones de los modelos.

Cuando los investigadores entrenaron los modelos en el segundo conjunto de datos, que contenía imágenes extraídas de una sola región y, por lo tanto, se presumió que era menos propenso a generar confusión, resultó no ser el caso; incluso esos modelos mostraron una caída correspondiente en el desempeño cuando se probaron con datos externos. Estos resultados anulan la sabiduría convencional de que la confusión plantea un problema menor cuando los conjuntos de datos se derivan de fuentes similares, y revelan hasta qué punto los llamados sistemas de IA médica de alto rendimiento podrían explotar atajos indeseables en lugar de las señales deseadas. A pesar de las preocupaciones planteadas por sus hallazgos, los investigadores creen que es poco probable que los modelos que estudiaron se hayan implementado ampliamente en el entorno clínico. Si bien hay evidencia de que al menos uno de los modelos defectuosos, COVID-Net, se implementó en varios hospitales, no está claro si se utilizó con fines clínicos o únicamente para la investigación. Según el equipo, los investigadores que buscan aplicar la IA a la detección de enfermedades deberán renovar su enfoque antes de que dichos modelos se puedan usar para tomar decisiones de tratamiento reales para los pacientes.

“Un modelo que se basa en atajos a menudo solo funcionará en el hospital en el que se desarrolló, por lo que cuando se lleva el sistema a un nuevo hospital, falla, y esa falla puede dirigir a los médicos hacia un diagnóstico y un tratamiento incorrectos”, explicó el estudiante de posgrado y coautor principal, Alex DeGrave. “Un médico generalmente esperaría que un hallazgo de COVID-19 en una radiografía se basara en patrones específicos en la imagen que reflejan los procesos de la enfermedad. Pero en lugar de depender de esos patrones, un sistema que utilice el aprendizaje de atajos podría, por ejemplo, juzgar que alguien es mayor y, por lo tanto, inferir que es más probable que tenga la enfermedad porque es más común en pacientes mayores. El atajo no es incorrecto per se, pero la asociación es inesperada y no transparente. Y eso podría llevar a un diagnóstico inadecuado”.

“Nuestros hallazgos apuntan a la importancia de aplicar técnicas de inteligencia artificial explicables para auditar rigurosamente los sistemas de inteligencia artificial médica”, dijo el coautor principal Joseph Janizek. “Si miras un puñado de rayos X, el sistema de IA puede parecer que se comporta bien. Los problemas solo se aclaran una vez que miras muchas imágenes. Hasta que tengamos métodos para auditar estos sistemas de manera más eficiente utilizando un tamaño de muestra mayor, una aplicación más sistemática de IA explicable podría ayudar a los investigadores a evitar algunos de los errores que identificamos con los modelos COVID-19”.

Enlace relacionado:

Facultad de Ciencias e Ingeniería Informática Paul G. Allen de la Universidad de Washington

Últimas COVID-19 noticias

- Inmunosensor nuevo allana el camino para pruebas rápidas POC para COVID-19 y enfermedades infecciosas emergentes

- Encuentran etiologías de COVID prolongada en muestras de sangre con infección aguda

- Dispositivo novedoso detecta anticuerpos contra la COVID-19 en cinco minutos

- Prueba para COVID-19 mediante CRISPR detecta SARS-CoV-2 en 30 minutos usando tijeras genéticas

- Asocian disbiosis del microbioma intestinal con la COVID-19

- Validan prueba rápida novedosa de antígeno para el SARS-CoV-2 con respecto a su exactitud diagnóstica

- Prueba nueva COVID + Influenza + VSR ayudará a estar preparados para la ‘tripledemia’

- IA elimina las conjeturas de las pruebas de flujo lateral

- Prueba de antígeno del SARS-CoV-2 más rápida, jamás diseñada, permite realizar pruebas de COVID-19 no invasivas en cualquier entorno

- Pruebas rápidas de antígeno detectan las variantes ómicron, delta del SARS-CoV-2

- Prueba en sangre realizada durante la infección inicial predice el riesgo de COVID prolongada

- Investigadores afirman que hay que crear “reservistas” de laboratorio para responder más rápidamente a la próxima pandemia

- Estudio encuentra que los profesionales sanitarios mostraron mayor interés en tecnologías POC durante la pandemia

- Plataforma de análisis de bajo costo para la COVID-19 combina sensibilidad de la PCR y velocidad de pruebas de antígeno

- Prueba de sangre por punción digital identifica inmunidad a la COVID-19

- Kit de prueba rápida determina inmunidad contra la COVID-19 y sus variantes

Canales

Química Clínica

ver canal

Espectrómetro de masas impreso en 3D para el punto de atención supera a los modelos de última generación

La espectrometría de masas es una técnica precisa para identificar los componentes químicos de una muestra y tiene un potencial significativo para monitorear estados de salud de enfermedades... Más.jpg)

Prueba biomédica POC hace girar una gota de agua utilizando ondas sonoras para detección del cáncer

Los exosomas, pequeñas biopartículas celulares que transportan un conjunto específico de proteínas, lípidos y materiales genéticos, desempeñan un papel... Más

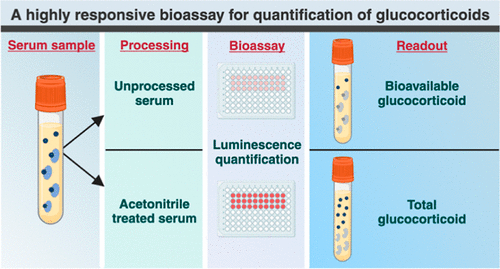

Prueba basada en células altamente confiable permite diagnóstico preciso de enfermedades endocrinas

Los métodos convencionales para medir el cortisol libre, la hormona del estrés del cuerpo, en la sangre o la saliva son bastante exigentes y requieren el procesamiento de muestras. Por lo tanto, el método... MásDiagnóstico Molecular

ver canal

Prueba de sangre predice con precisión el riesgo de cáncer de pulmón y reduce la necesidad de escaneos de TC

El cáncer de pulmón es extremadamente difícil de detectar tempranamente debido a las limitaciones de las tecnologías de detección actuales, que son costosas, a veces... Más

Firma única de autoanticuerpos ayuda a diagnosticar la esclerosis múltiple años antes de la aparición de síntomas

Se cree que las enfermedades autoinmunes como la esclerosis múltiple (EM) ocurren en parte debido a respuestas inmunes inusuales a infecciones comunes. Los primeros síntomas de la EM, incluidos... Más

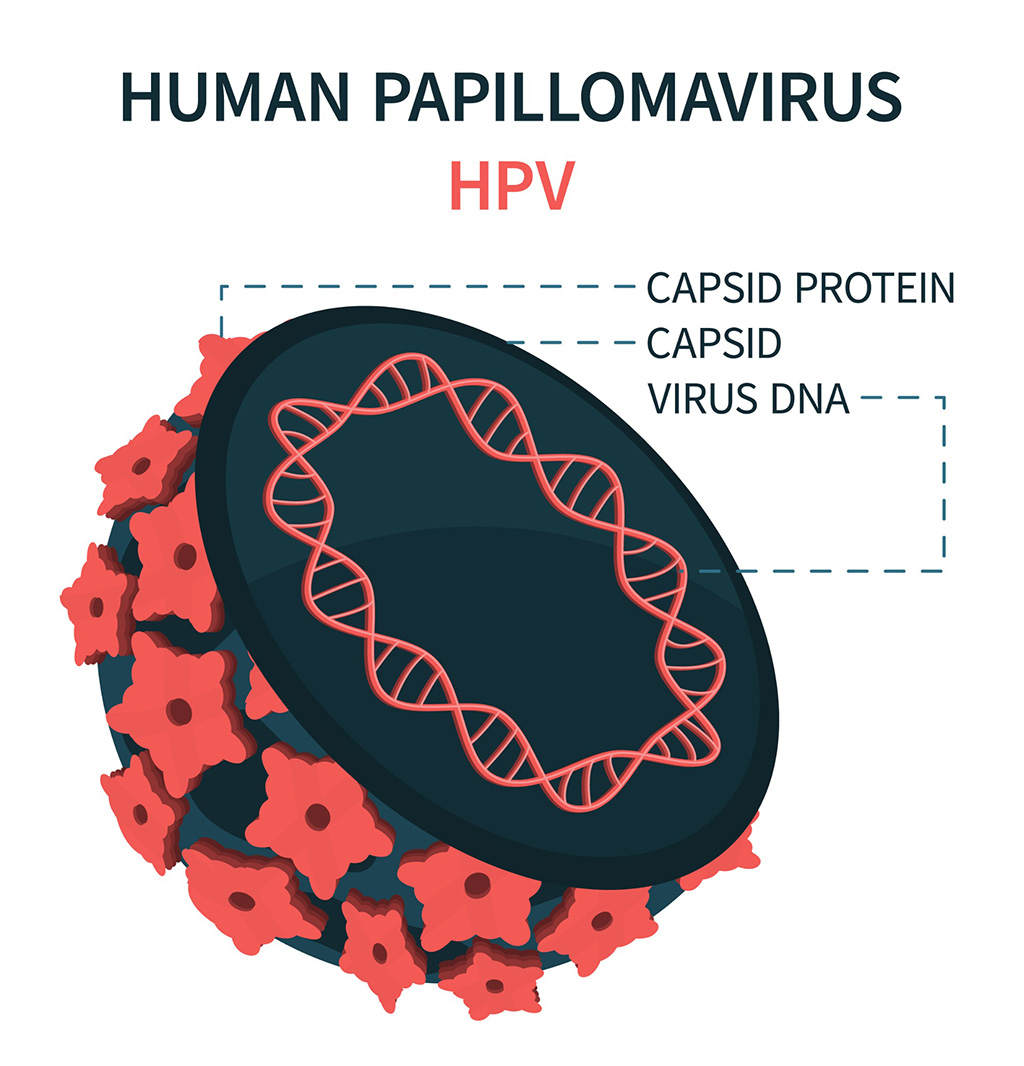

Prueba de sangre podría detectar cánceres asociados al VPH 10 años antes del diagnóstico clínico

Se sabe que el virus del papiloma humano (VPH) causa varios cánceres, incluidos los de genitales, ano, boca, garganta y cuello uterino. El cáncer orofaríngeo asociado al VPH (VPH+COF)... Más

Un diagnóstico de bajo costo en el punto de atención ampliará el acceso a pruebas de enfermedades de transmisión sexual

La gonorrea es la segunda infección bacteriana de transmisión sexual (ITS) más comúnmente reportada, con alrededor de 82 millones de casos en todo el mundo en 2020. La infección puede tener graves consecuencias... MásHematología

ver canal

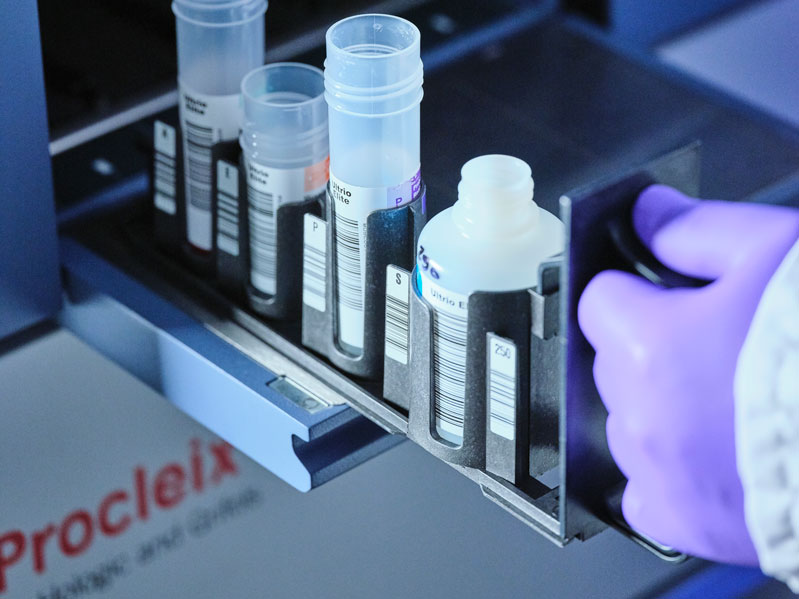

Primera prueba NAT 4 en 1 para el cribado de arbovirus podría reducir el riesgo de infecciones transmitidas por transfusiones

Los arbovirus representan una amenaza emergente para la salud mundial, exacerbada por el cambio climático y el aumento de la conectividad mundial que está facilitando su propagación a nuevas regiones.... Más

Instrumento de próxima generación detecta trastornos de la hemoglobina en recién nacidos

Las hemoglobinopatías, las enfermedades hereditarias más extendidas a nivel mundial, afectan a alrededor del 7 % de la población como portadores, y el 2,7 % de los recién nacidos nacen con estas enfermedades.... Más

Prueba de sangre POC por punción digital determina riesgo de sepsis neutropénica en pacientes sometidos a quimioterapia

La neutropenia, una disminución de los neutrófilos (un tipo de glóbulo blanco crucial para combatir las infecciones), es un efecto secundario frecuente de ciertos tratamientos contra... Más

Primera prueba rápida y asequible para beta talasemia demuestra precisión diagnóstica del 99 %

Los trastornos de la hemoglobina se encuentran entre las enfermedades monogénicas más prevalentes a nivel mundial. Entre los diversos trastornos de la hemoglobina, la beta talasemia, un trastorno sanguíneo... MásInmunología

ver canal

Análisis de sangre para diagnóstico de rechazo celular después de trasplante de órganos podría reemplazar las biopsias quirúrgicas

Los órganos trasplantados enfrentan constantemente el riesgo de ser rechazados por el sistema inmunológico del receptor, que los diferencia de los órganos no propios mediante... Más

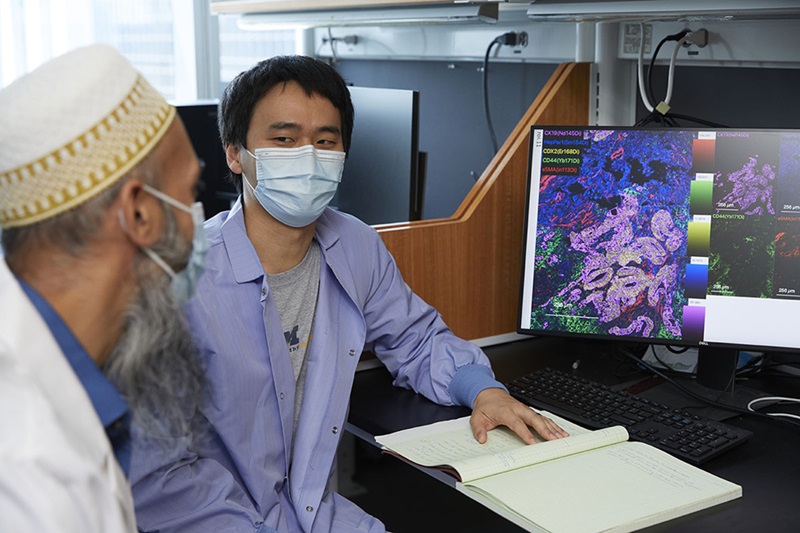

Herramienta de IA ajusta con precisión los medicamentos contra el cáncer con los pacientes utilizando información de cada célula tumoral

Las estrategias actuales para emparejar a los pacientes con cáncer con tratamientos específicos a menudo dependen de la secuenciación masiva de ADN y ARN tumoral, que proporciona un perfil promedio de... Más

Pruebas genéticas combinadas con la detección de fármacos personalizadas en muestras de tumores podrían revolucionar el tratamiento del cáncer

El tratamiento del cáncer generalmente se adhiere a un estándar de atención: regímenes establecidos y validados estadísticamente que son efectivos para la mayoría de los pacientes. Sin embargo, la variabilidad... Más

Método de prueba podría ayudar a más pacientes recibir tratamiento adecuado contra el cáncer

El tratamiento del cáncer no siempre es una solución única, pero el campo de la investigación del cáncer está dando grandes pasos para encontrar a los pacientes los tratamientos más eficaces para sus afecciones... MásMicrobiología

ver canal

Nuevos ensayos de hepatitis con marcado CE permite la detección temprana de infecciones

Según la Organización Mundial de la Salud (OMS), se estima que 354 millones de personas en todo el mundo padecen hepatitis B o C crónica. Estos virus son las principales causas de... Más

Prueba de PCR múltiplex identifica el 95 % de los patógenos que causan la sepsis en una hora

La sepsis contribuye a una de cada tres muertes hospitalarias en los Estados Unidos y, a nivel mundial, el shock séptico conlleva una tasa de mortalidad del 30 al 40 %. El diagnóstico temprano... Más

Prueba de bacterias bucales podría predecir la progresión del cáncer de colon

El cáncer de colon, una enfermedad relativamente común pero difícil de diagnosticar, requiere confirmación mediante una colonoscopia o cirugía. Recientemente, ha habido... Más.jpg)

Firma metabólica unica podría permitir el diagnóstico de sepsis dentro de una hora de la extracción de sangre

La sepsis es una afección potencialmente mortal provocada por una respuesta extrema del cuerpo a una infección. Requiere intervención médica inmediata para evitar una posible muerte o daños duraderos.... MásPatología

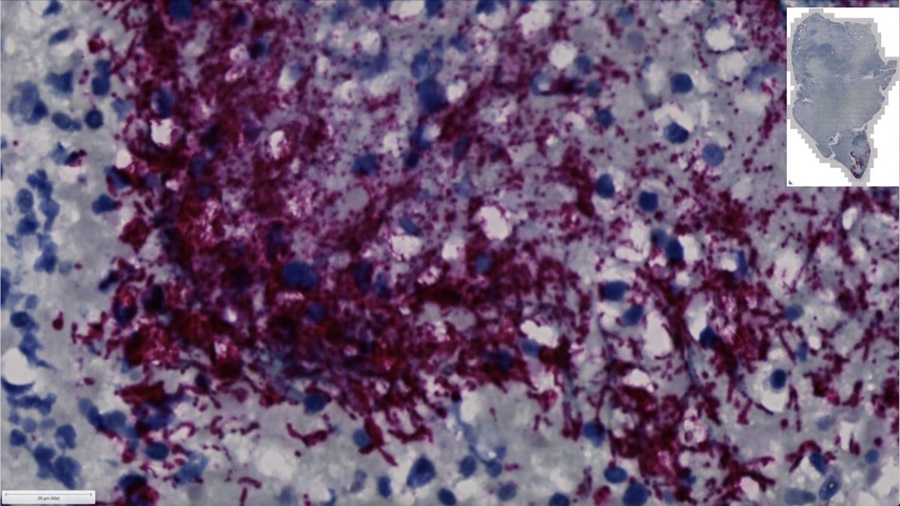

ver canalSistema de imágenes digitales impulsado por IA podría revolucionar el diagnóstico del cáncer

El proceso de biopsia es importante para confirmar la presencia de cáncer. En la técnica de histopatología convencional, el tejido se extirpa, se corta, se tiñe, se monta en... Más

Nuevo panel de mycobacterium tuberculosis respalda la vigilancia en tiempo real y combate la resistencia a los antimicrobianos

La tuberculosis (TB), la principal causa de muerte por enfermedad infecciosa a nivel mundial, es una infección bacteriana contagiosa que se propaga principalmente a través de la tos de pacientes con tuberculosis... Más

Análisis de tejido espacial identifica patrones asociados con la recaída del cáncer de ovario

El carcinoma de ovario seroso de alto grado es el tipo más letal de cáncer de ovario y plantea importantes desafíos de detección. Por lo general, los pacientes responden inicialmente... Más

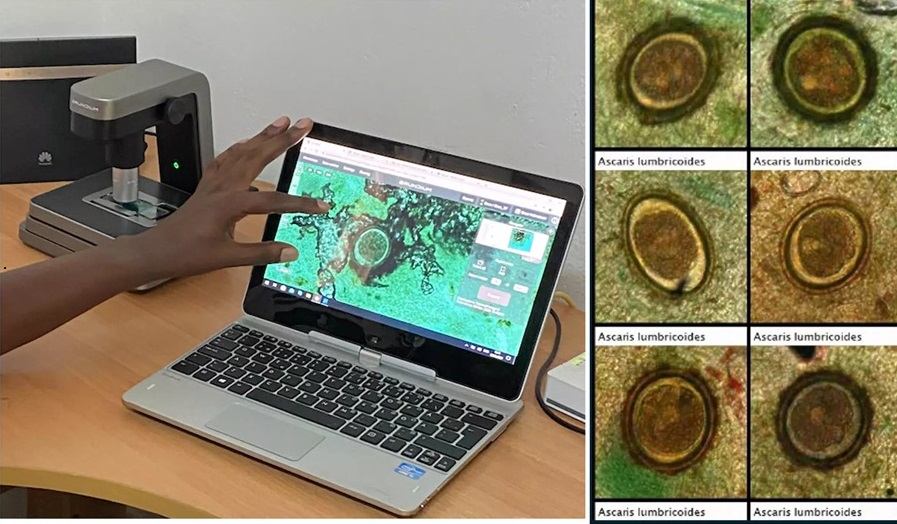

IA basada en imágenes se muestra prometedora para detección de parásitos en muestras de heces digitalizadas

Las infecciones por helmintos transmitidos por el suelo (STH), comúnmente conocidas como gusanos parásitos intestinales, se encuentran entre las enfermedades tropicales desatendidas más... MásTecnología

ver canal

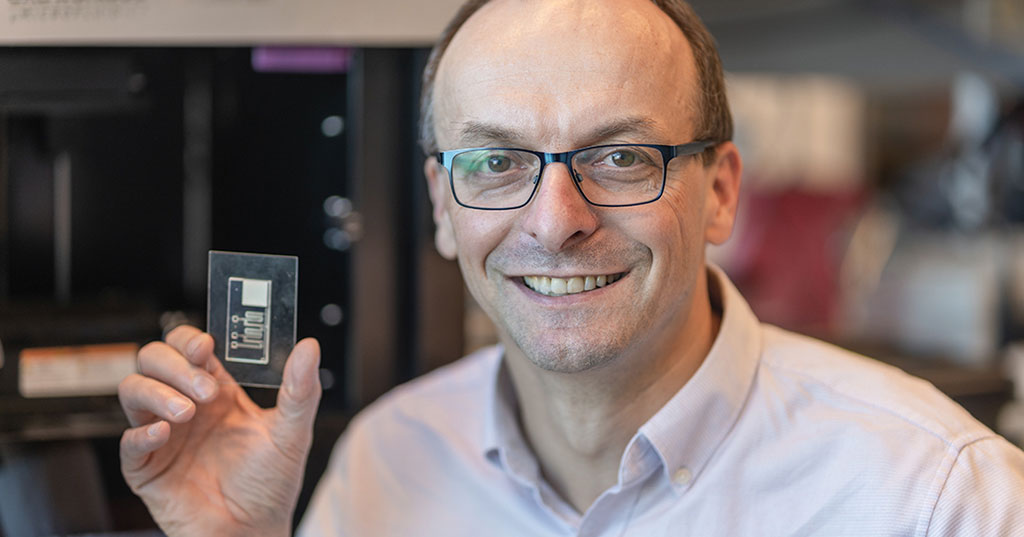

Nuevo sistema de diagnóstico de laboratorio en un chip iguala la precisión de las pruebas de PCR

Si bien las pruebas de PCR son el estándar de oro en cuanto a precisión para las pruebas de virología, tienen limitaciones como la complejidad, la necesidad de operadores de laboratorio capacitados y tiempos... Más

Biosensor de ADN permite diagnóstico temprano del cáncer de cuello uterino

El disulfuro de molibdeno (MoS2), reconocido por su potencial para formar nanoláminas bidimensionales como el grafeno, es un material que llama cada vez más la atención de la comunidad... Más

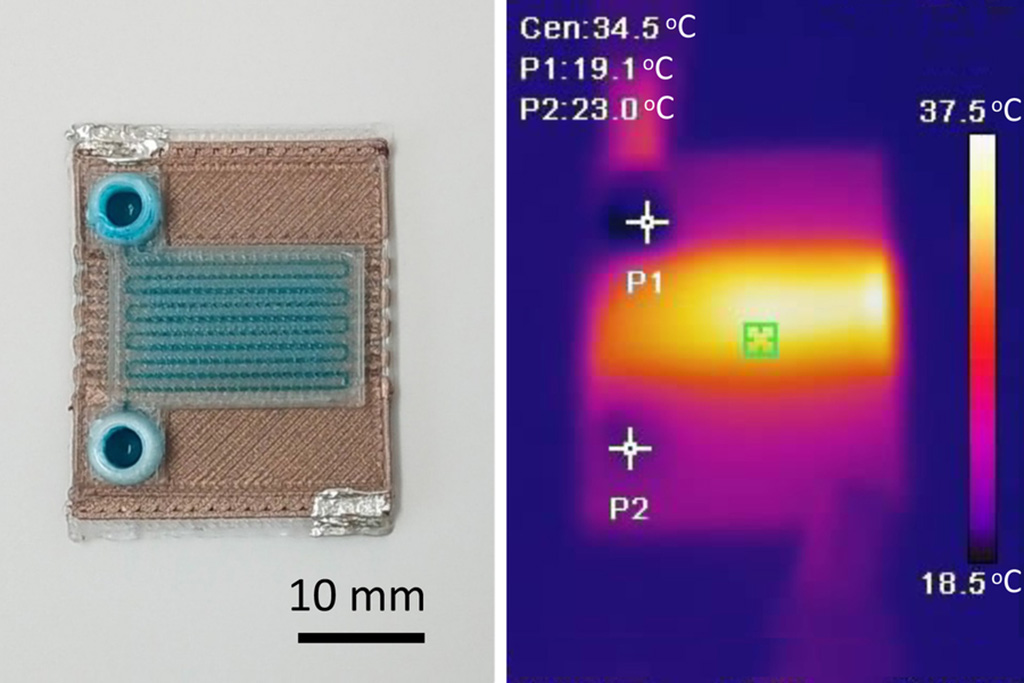

Dispositivos de microfluidos autocalentables pueden detectar enfermedades en pequeñas muestras de sangre o fluidos

Los microfluidos, que son dispositivos en miniatura que controlan el flujo de líquidos y facilitan reacciones químicas, desempeñan un papel clave en la detección de enfermedades... Más

Avance en tecnología de diagnóstico podría hacer que pruebas en el sitio sean ampliamente accesibles

Las pruebas caseras adquirieron una importancia significativa durante la pandemia de COVID-19, sin embargo, la disponibilidad de pruebas rápidas es limitada y la mayoría de ellas solo pueden conducir un... MásIndustria

ver canal

Congreso ECCMID cambia de nombre a ESCMID Global

En los últimos años, la Sociedad Europea de Microbiología Clínica y Enfermedades Infecciosas (ESCMID, Basilea, Suiza) ha evolucionado notablemente. La sociedad es ahora más... Más