Herramienta de IA transforma detección del cáncer de piel con alta precisión

Actualizado el 27 Nov 2025

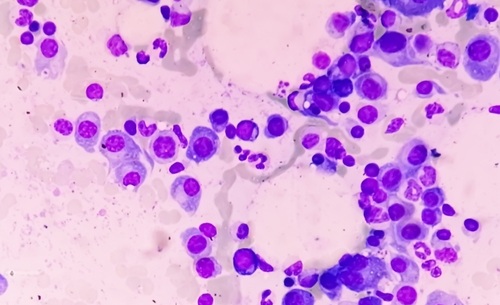

El melanoma sigue siendo uno de los cánceres de piel más difíciles de diagnosticar, ya que a menudo se asemeja a lunares inofensivos o lesiones benignas. Las herramientas tradicionales de IA dependen en gran medida de las imágenes dermatoscópicas, pasando por alto detalles clínicos importantes como la edad, el sexo o la ubicación de la lesión del paciente, que pueden afectar la precisión del diagnóstico. Estas limitaciones subrayan la necesidad de enfoques diagnósticos más integrados. Ahora, una nueva solución de IA multimodal permite combinar las características de la imagen con el contexto del paciente para una detección más precisa del melanoma.

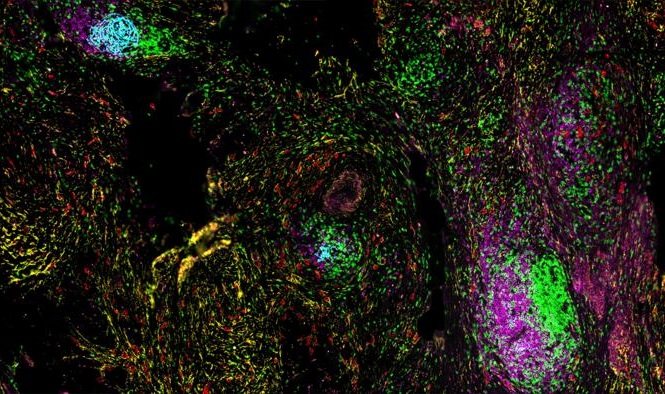

Investigadores de la Universidad Nacional de Incheon (Incheon, Corea del Sur), en colaboración con la Universidad del Oeste de Inglaterra (Bristol, Reino Unido) y otras instituciones líderes, han creado un modelo de aprendizaje profundo que combina imágenes dermatoscópicas con metadatos clínicos para distinguir mejor el melanoma de las lesiones benignas. Su sistema se entrenó utilizando el conjunto de datos SIIM-ISIC, que incluye más de 33.000 pares de imágenes dermatoscópicas e información del paciente.

El modelo integra características visuales con detalles como la edad del paciente, el tamaño de la lesión y la localización anatómica para capturar patrones que los sistemas basados en imágenes podrían pasar por alto. Esta fusión multimodal permite a la red identificar indicios diagnósticos sutiles y alinearlos con los factores de riesgo específicos del paciente. Utilizando el conjunto de datos a gran escala, el modelo alcanzó una precisión diagnóstica del 94,5 % y una puntuación F1 de 0,94, superando así el rendimiento de arquitecturas basadas en imágenes comunes, como ResNet-50 y EfficientNet.

El análisis de importancia de las características mostró que la incorporación de metadatos del paciente fortaleció significativamente las predicciones y mejoró la transparencia del modelo. El estudio destacó que factores como la ubicación de la lesión y la edad del paciente contribuyeron significativamente a la clasificación del melanoma. Estos hallazgos, publicados en Information Fusion, demuestran el potencial de los sistemas multimodales para reducir la clasificación errónea y mejorar la fiabilidad en comparación con las herramientas de IA basadas únicamente en imágenes.

La combinación de características visuales y clínicas proporciona una visión más completa del riesgo de melanoma y facilita un diagnóstico más fiable. El enfoque multimodal podría integrarse en los flujos de trabajo clínicos para apoyar a los dermatólogos en la identificación temprana del melanoma, especialmente en entornos con acceso limitado a especialistas. Su estructura también lo hace adecuado para su implementación en aplicaciones de detección para teléfonos inteligentes y plataformas de telemedicina. Esta tecnología ofrece una manera de ampliar los esfuerzos de detección temprana y reducir la dependencia exclusiva de la evaluación visual.

El desarrollo futuro podría adaptar el modelo a sistemas de diagnóstico del mundo real que analizan tanto imágenes como datos básicos del paciente para orientar la intervención temprana. Al vincular la inteligencia artificial con el contexto clínico, este enfoque puede ayudar a crear diagnósticos de cáncer de piel más personalizados, precisos y accesibles.

“El modelo no está diseñado únicamente con fines académicos. Podría utilizarse como una herramienta práctica que transformaría la detección del melanoma en el mundo real”, afirmó el profesor Gwangill Jeon. “Esta investigación puede aplicarse directamente al desarrollo de un sistema de IA que analice tanto imágenes de lesiones cutáneas como información básica del paciente para facilitar la detección temprana del melanoma”.

Enlaces relacionados:

Universidad Nacional de Incheon

Universidad del Oeste de Inglaterra

.jpg)